MI SELECCIÓN DE NOTICIAS

Noticias personalizadas, de acuerdo a sus temas de interés

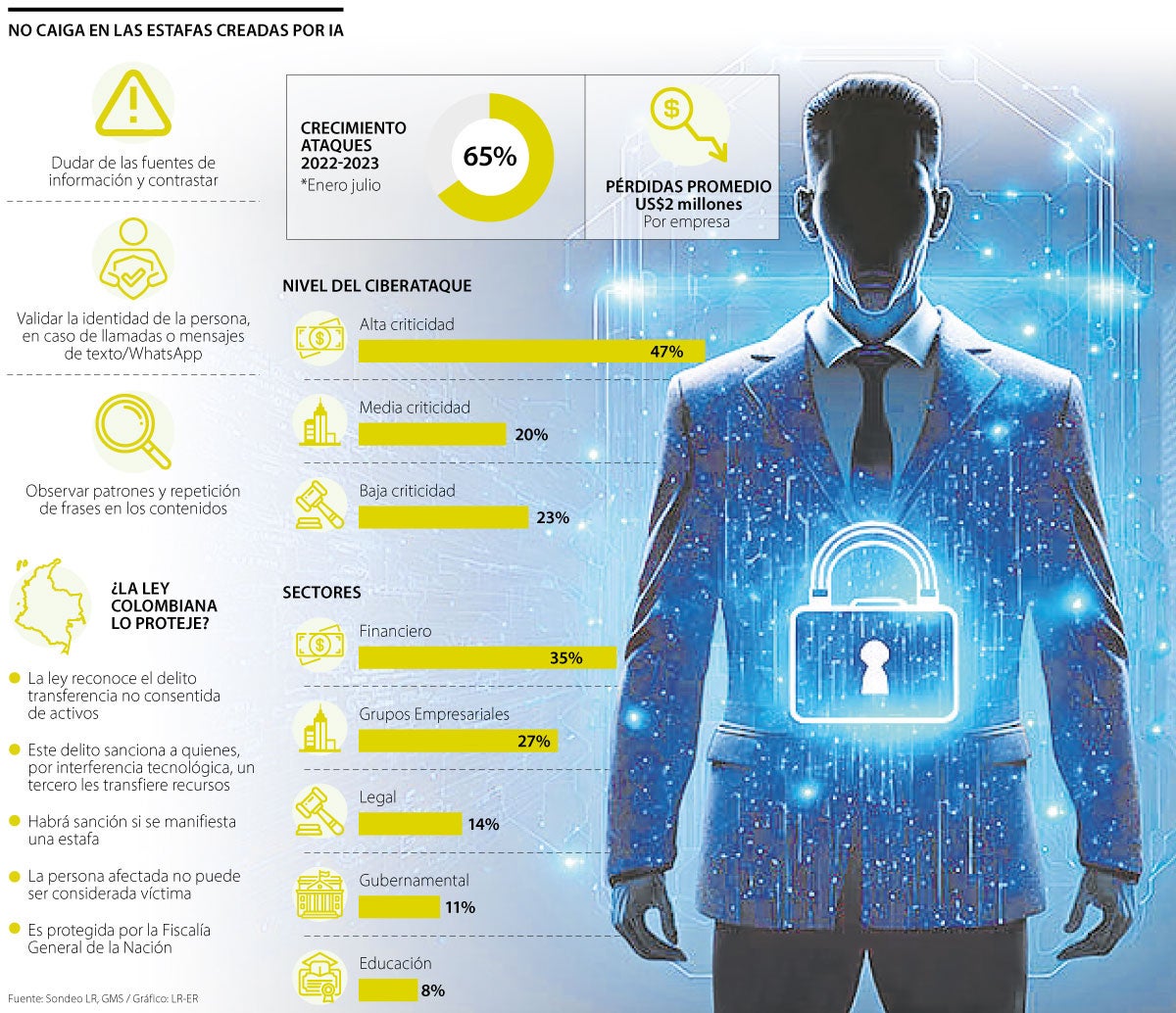

Estas son las claves para evitar caer en estafas impulsadas por la inteligencia artificial

Entre los consejos está buscar el origen de la fuente de la información, así como usar herramientas tecnológicas para detectarlo

Aunque buena parte de las nuevas tecnologías, como la inteligencia artificial, pueden ser beneficiosas para el ser humano, mucho se ha debatido sobre los límites y regulación que se estas deben tener.

Muchos han alertado de los efectos y consecuencias de la inteligencia artificial, como Saxo Bank, que el año pasado alertó entre sus cisnes negros una crisis de seguridad por la IA. Como suele ocurrir en otros contextos, los avances tecnológicos han sido empleados en distintas ocasiones para violar la ley, y la inteligencia artificial no ha sido la excepción para cometer ciberdelitos.

No falta irse a otros países más desarrollados en materia tecnológica, pues en Colombia ya aparecieron algunos casos. Hace unas semanas, comenzó a circular una presunta campaña del futbolista Luis Díaz, en la que convocaba a donaciones para un proyecto futbolístico.

“Crecí en una familia pobre y quiero ayudar a los colombianos. Daniela y yo creemos que todos deben ser independientes económicamente (...) Solo necesitas teléfono e internet para participar. Multiplica tu inversión en pocas horas”, decía el falso testimonio del jugador del Liverpool de Inglaterra.

El vídeo podría tener cierto grado de credibilidad para las personas, toda vez que también se utilizaba la imagen y la voz, ambas alteradas, de una reconocida presentadora de noticias de un canal de televisión.

Según expertos, este se trataría del primer caso evidenciado de deepfake en el país. Esta es una técnica en la que, por medio de inteligencia artificial, modifican la voz y la expresión facial de un reconocido personaje para enviar un mensaje o cometer un fraude, como en este caso, y que se difunde masivamente por las redes sociales.

En las últimas horas también se conocieron otros vídeos de este estilo, pero con otros miembros de la selección colombiana como James Rodríguez.

“Una realidad del mundo moderno es el auge de la inteligencia artificial, especialmente en el mundo de la tecnología. Es por ello que un ciberdelincuente, que tenga la destreza y malicia necesaria, puede utilizar la IA como vehículo para cometer sus delitos”, aseguró Bibiana Cala, socia de derecho penal corporativo de Baker McKenzie.

Además del uso de la herramienta para la creación de audios y vídeos falsos, como en el caso del futbolista colombiano, también se puede usar, aseguró Francisco González, docente del Politécnico Grancolombiano, en el perfeccionamiento de los mensajes de phishing o suplantación “para que sean más convincentes y el destinatario no pueda detectarlo tan fácilmente”.

“La IA puede utilizarse para crear contenido falso como textos, audios o vídeos con el propósito de engañar a las personas. Puntualmente se pueden utilizar algoritmos de aprendizaje automático para estudiar y analizar el comportamiento de una persona y así construir estrategias de ingeniería social que sean más efectivas”, puntualizó González, miembro de la Escuela TIC de la institución.

Los expertos coinciden en que el autocuidado es la principal clave para que usted, como usuario, no sea estafado.

“Si recibe una llamada desconocida, pero quien habla parece ser un familiar, hay que preguntarse desde al instante ¿Por qué me llama desde una línea extraña?”, cuestionó Cala.

La abogada también recomendó establecer un mecanismo de seguridad con los familiares, en este caso una batería de preguntas, que puedan ayudar a identificar un posible intento del delito.

El catedrático también aseguró que hay algunos patrones o señales que permiten inferir que un material fue creado por inteligencia artificial. Por ejemplo, en el caso de un texto, se presenta una repetición de frases o patrones.

También fíjese si hay una falta de coherencia o el estilo de la escritura. “Existen en línea múltiples herramientas gratuitas y de pago que permiten analizar un texto e identificar si fue creado por una IA o no (...) Google incluye una funcionalidad para analizar una imagen y ver cómo fue generada”, apuntó el experto.

Desde un punto de vista legal, la persona que es víctima de estos delitos, “no puede ser castigado por ser víctima, especialmente si las mismas presentan un alto grado de complejidad”, aseguró la experta Bibiana Cala.

“Con los avances de la IA en los últimos años, cada vez es más complejo determinar qué es real y qué es generado por las computadoras. Es por esto que la víctima no puede ser revictimizada ni juzgada por caer en estos engaños, por el contrario, es protegida por la Fiscalía General de la Nación y por las autoridades competentes”, complementó la abogada.

El docente Francisco González, recomendó, desde un punto de vista pragmático, “siempre dudar del origen de los contenidos y verificar, en lo posible, con la fuente original de la información”.

De momento, la crisis de seguridad por la IA parece ser un facto más allá de un cisne negro anunciado por Saxo Bank.

Con una estrategia que combina precios bajos, DHGate se presenta como una alternativa digital al por mayor, pero con la posibilidad de realizar compras individuales

En 2024, la Unión Americana tuvo el mayor número de empresas de inteligencia artificial creadas con 1.073 frente a 98 de China

Ver a más niñas y jóvenes interesadas en las carreras Stem es una señal de progreso, Pero para que este cambio sea posible y sostenible en el tiempo, necesitamos seguir apostando por la formación